国内外学者首次理论证明:量子纠缠加速量子模拟

产业动态 | 发布时间:2025-07-16 | 阅读:580 次合肥国家实验室/复旦大学周游教授与香港大学计算机系赵琦教授、美国马里兰大学 Andrew Childs 教授合作,系统性探讨了量子纠缠与多体量子模拟算法之间的深层联系,创新性地提出了基于纠缠熵的量子模拟误差上界,并开发了基于纠缠信息的自适应测量误差动态优化算法。研究首次从理论上证明:虽然高度纠缠的量子系统会极大提升经典计算机的模拟难度,却能显著提高量子计算机的模拟效率,从而为实现“量子优越性”提供了全新理论支撑。相关研究论文于7月14日在以“Entanglement accelerates quantum simulation(量子纠缠加速量子模拟)”为题发表在国际学术期刊《自然·物理》(Nature Physics)上。

© Nature Physics

本项研究首次建立了纠缠熵与Trotter量子模拟算法误差的定量关系。令人意外的是,随着系统纠缠程度提升,相关算法误差反而减小,并趋近于算法误差的平均表现。在前期工作中,团队已证明量子模拟算法误差的平均表现可较以往大幅减小,部分系统中甚至可达随粒子数平方根级别的下降Zhao, Zhou, Shaw, Li, Childs, Physical Review Letters 129, 270502 (2022)]。

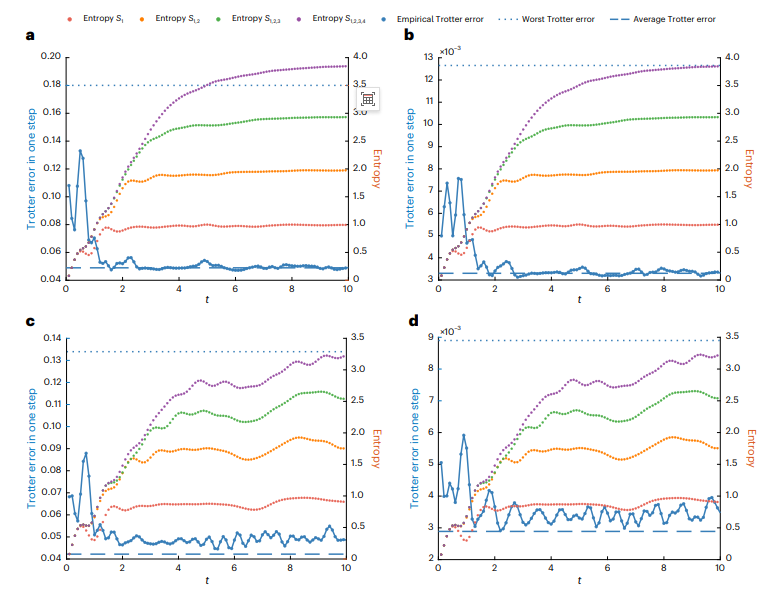

研究人员通过数值模拟验证了该理论:如典型参数下的量子横场伊辛模型(QIMF),随着演化态纠缠熵迅速增长,同时一阶和二阶Trotter 模拟误差均降低并收敛至平均值。相反,非典型参数下,纠缠熵增长缓慢,误差也难以显著收敛。

图 1:纠缠熵与模拟误差的演化趋势: 本图左右两侧 Y 轴分别表示系统纠缠熵(右)和量子模拟误差(左)。随着时间推移,部分参数下纠缠熵迅速升高,模拟误差则同步下降并趋于稳定, 并接近平均误差分析(a,b);而在其他参数下,纠缠熵变化缓慢,误差也难以明显降低到平均误差水平(出 c, d)。

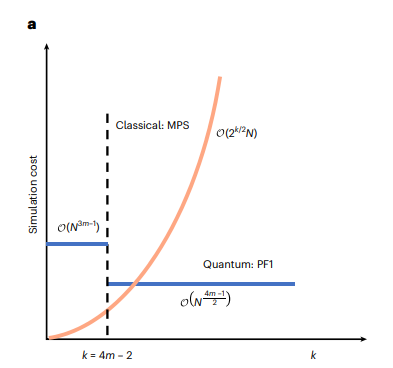

在长时间量子模拟任务中,纠缠迅速增长并达到“加速阈值”,使算法整体效率与平均表现相当,大幅优于传统最坏情形下的资源消耗。如图 2 所示,随着纠缠程度增加,经典张量网络方法资源消耗呈指数增长,而量子模拟依然可在多项式资源下高效完成。当纠缠突破特定阈值后,所需资源进一步降低,充分展现出量子纠缠带来的“模拟加速效应”。

图 2:本图对比了在不同纠缠程度下, 量子算法与经典算法进行 多体量子系统模拟时的资源消耗。 随着纠缠程度的提升, 经典模拟方法所需资源呈指数级增加, 而量子模拟的资源消耗则保持在多项式水平, 且在高纠缠区域该消耗进一步降低, 显著优于经典方法。

为充分利用该现象,团队提出了基于纠缠信息的自适应量子模拟算法:在演化过程中动态测量纠缠熵或误差,据此调整 Trotter 步长,实现与平均误差分析相当的线路深度。更重要的是,这一“纠缠加速”现象不仅适用于本工作研究的模型,还可望推广至更复杂的量子绝热算法与量子相位估计算法。

该成果不仅深化了对量子纠缠物理本质的理解,也为高效量子模拟与量子信息处理奠定了坚实基础,预计将在量子计算、材料模拟等前沿领域产生重要影响。未来,这一发现有望推动化学、凝聚态物理、核物理等领域的高效量子模拟,助力科学家更深入探索自然界奥秘。

相关工作得到了合肥国家实验室、国家自然科学基金、香港研究资助局、上海市科技创新行动计划、复旦大学基础研究特区项目等项目的支持。

论文链接:https://www.nature.com/articles/s41567-025-02945-2

信息来源:“量子科话”微信公众号